我跟你们说,这个g空间,我以前也是一头雾水,听着就高大上,感觉不是我们这种野路子能碰的。我第一次真正被逼着去啃它,是在前年,当时我接了一个外包活,是给一家小型的金融科技公司做数据流优化。他们那个系统,跑着跑着就卡死,内存占用忽高忽低,完全没有规律。

实践的开始:被逼上梁山

我当时信心满满,觉得不就是调优嘛我以前搞过多少次了。我先是翻查了他们现有的代码和架构图,发现他们大量使用了某开源框架,而那个框架的核心逻辑,就跟g空间的概念脱不开关系。我一开始想绕过去,搞一些治标不治本的优化,比如加大缓存,分片处理。结果?一点用都没有,跑一段时间,系统还是得给我跪。

老板急了,直接打电话来骂我,说再搞不定就要扣尾款。我当时真是气得不行,但没办法,钱是老大。我知道我必须得从根上解决了。我意识到,我之前学的东西太浮在表面了,如果不把g空间里头那些核心的“维度”和“映射”关系搞明白,我永远只是在外面挠痒痒。

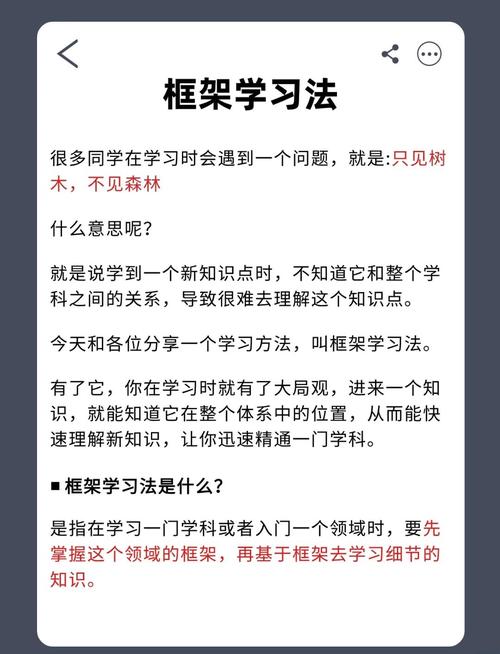

我决定从头开始。但我没有去买那些厚厚的教材,那些书对我来说就是催眠药。我选择了一个最笨的办法:逆向工程和实地观察。

放下理论,开始实操:我的土办法

我做的第一件事,就是把那个开源框架的最小可运行版本给剥离出来,然后我架设了一个模拟环境。我的目标很简单,不是理解g是什么,而是看g是如何影响数据的“行走路径”的。

- 我建立了五个最简单的数据节点,编号1到5。

- 我设计了三种不同的交互模式,让它们循环跑起来。

- 然后我编写了一个粗糙的日志记录工具,专门用来追踪数据在节点之间跳跃时,那个所谓的“g参数”到底是怎么变化的。

这个过程很枯燥,我整整花了一个星期,不停地运行、记录、对比。我没试图用数学公式去证明什么,我只是用眼睛去“看”现象。一开始的结果是一团乱麻,日志文件几百兆,我根本找不到规律。

我当时差点想放弃,心想这玩意儿是不是玄学?就在我准备关掉电脑去睡觉的时候,我无意中调整了一个配置参数,就是那个控制“数据聚合密度”的参数。我把它从默认的100调到了10。

奇迹出现了!

核心知识点的“土”解密

当我把密度调低后,数据的跳跃路径立刻变得清晰起来。我发现,以前那些看似随机的卡顿和内存暴涨,都是因为数据在g空间里被“压缩”得太厉害了,它们不得不挤在同一条狭窄的“通道”里排队,造成了严重的“堵车”。

我立刻意识到g空间的核心知识点,根本不是那些复杂的矩阵或者拓扑结构,而是两件事:

第一,维度的感知与简化。

g空间试图用一套逻辑去管理很多维度的信息。教科书总告诉你维度有多少多少,但实际应用中,你不需要把所有维度都考虑进去。你只需要识别出对你当前业务影响最大的那两三个关键维度,然后把其他的全部“钝化”或者“合并”。我之前的问题,就是被无关紧要的维度信息干扰了判断。

第二,资源的映射与隔离。

g空间的最牛逼之处,在于它能让你在逻辑上把资源(比如内存、带宽、计算力)“映射”到特定的数据流上。我以前以为这个映射是自动的,但通过手动调整密度参数,我明白了,这个映射需要我们自己去“定义边界”。当你把边界画清楚了,数据就不会乱跑,资源就不会被无效占用。这就像是你在小区里给每栋楼都划定了专门的停车位,而不是让车随便乱停。

的实现与总结

搞明白了这两点,后面的优化就水到渠成了。我立刻重构了数据输入模块,修改了关键的聚合参数,并手动介入了资源映射的逻辑。系统跑起来,流畅得不像话。以前动不动就90%的CPU占用,现在稳稳地压在30%以下。

我把这个成果拿给甲方看,他们都惊呆了,以为我用了什么黑科技。哪里有什么黑科技,就是我放弃了看书本上那些高深的定义,扎下去用最粗糙的工具,把现象一遍遍跑出来,直到它亲口告诉我它是怎么运行的。

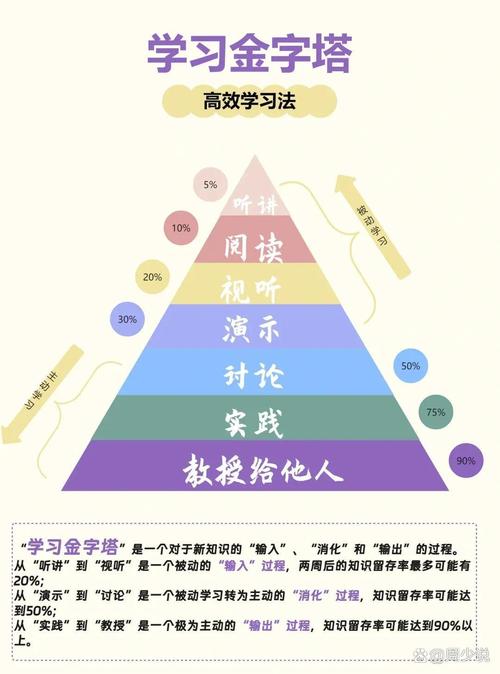

所以说,要学习和理解g空间这种抽象的概念,你不能光听别人讲,或者看那些复杂的公式。你得自己动手搭一个沙盘,然后推着数据小车在里面跑,跑明白了,你就真懂了。知识不是靠背诵的,是靠你亲手实践磨出来的。